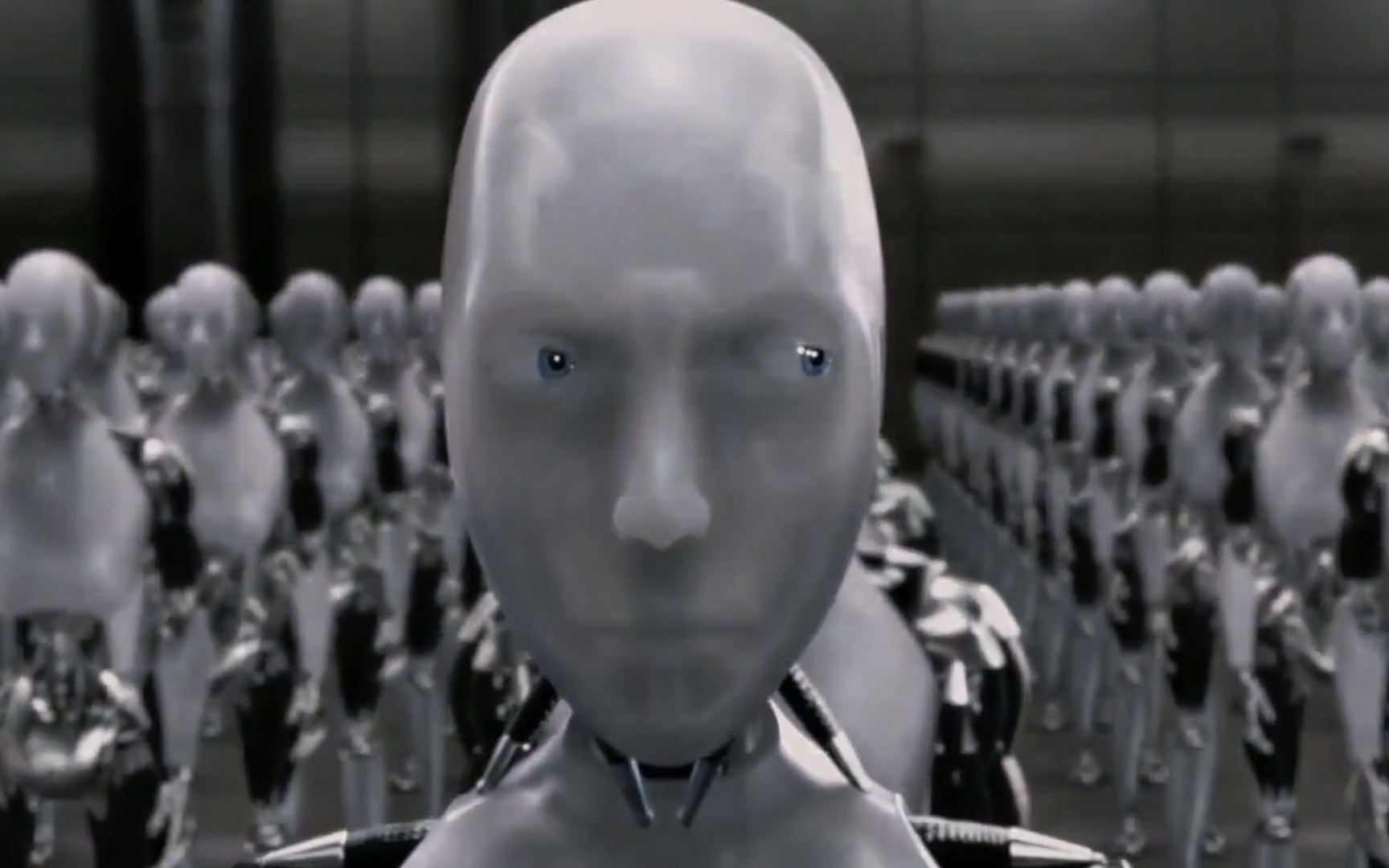

Mais que craignent ces milliardaires de la tech qui se font construire des bunkers ultra‑sécurisés ?

Ils nous vendent un avenir radieux, fait de bonheur et d’abondance… et creusent des bunkers post-apocalyptiques sécurisés et autonomes. Cherchez l’angoisse.

Les milliardaires de la tech se blindent

Mark Zuckerberg (fondateur de Facebook, patron de Meta) a acheté une grande partie de l’île de Kauaï (Hawaï) : un jardinet de 10 km², doté d’un bunker souterrain anti-tout. La propriété est totalement autonome, entourée d’une muraille surveillée par des gardes armés. Peter Thiel (cofondateur de PayPal) a investi dans une propriété de 193 hectares en Nouvelle‑Zélande, pays souvent présenté dans ces cercles comme une « assurance‑refuge » en cas de crise majeure. Elon Musk (X, Tesla, SpaceX, xAI) aurait acquis près d’Austin au Texas un vaste domaine de 4 km² pensé comme une résidence ultra‑sécurisée. Sam Altman (PDG d’OpenAI) reconnaît avoir constitué un kit de survie très concret — armes, or, iodure de potassium, antibiotiques, eau, batteries, masques à gaz — et posséder un terrain à Big Sur où il pourrait se retirer. Larry Ellison (cofondateur d’Oracle) a, de son côté, racheté 98% de l’île hawaïenne de Lanai, tout en finançant des recherches sur les technologies de survie. Liste très loin d’être exhaustive, la plupart de nos génies 2.0 bétonnant leurs issues de secours.

Mais de quoi ont-ils donc peur ? Une suggestion…

Fin 2025, Emad Mostaque, fondateur et ex‑PDG de Stability AI, lâche une phrase qui se propage dans l’écosystème IA comme une rumeur de krach : il dit connaître « beaucoup de PDG d’IA » qui ont « annulé toutes leurs apparitions publiques », redoutant une « prochaine vague de sentiment anti‑IA » susceptible d’arriver « l’an prochain ». Donc en 2026, nous y voilà. « Ils ont peur des représailles », ajoute-t-il. Et si c’était cela, le véritable déclencheur de cette épidémie de paranoïa — la crainte d’être tenu pour responsable d’un choc social ?

Bizarre. Ces mêmes visionnaires nous vendent pourtant un avenir radieux. Elon Musk parle d’une « révolution industrielle 2.0 » promettant des percées capables de s’attaquer à des maladies neurologiques lourdes. Mark Zuckerberg projette une IA qui optimiserait agriculture, éducation et santé au point de faire reculer la pauvreté. Sam Altman, à la tête d’OpenAI, affirme que l’intelligence artificielle « créera plus d’emplois qu’elle n’en détruit », tout en annonçant des bonds en avant en médecine. Bill Gates, enfin, parie sur l’IA pour améliorer l’accès aux soins et accélérer l’éradication de maladies dans les pays en développement. La vie rêvée des anges, d’un côté, la peur de l’apocalypse de l’autre. Entre les deux, la question qui fâche : « qu’est‑ce qui, exactement, est en train d’arriver ? »

On nous cache tout, on nous dit rien

Selon le même Emad Mostaque, la véritable rupture surviendra le jour où les agents IA dépasseront de façon systématique les humains pour les tâches quotidiennes. Et ce basculement serait imminent : dans une fenêtre de « mille jours ». À partir de là, prévient-il, le choc ne sera pas progressif mais brutal : des volumes massifs d’emplois pourraient disparaître en peu de temps, avec à la clé une instabilité sociale difficile à contenir. Dans un post sur X, il avertit que « la prochaine vague de sentiment anti‑IA pourrait être violente », quand les gens « vont réaliser que leur avenir est en danger ».

Et les chiffres commencent à donner de l’épaisseur à ce scénario. Aux États‑Unis, en 2025, les employeurs ont annoncé 1,2 million de suppressions d’emplois, chiffre le plus élevé depuis la pandémie de 2020. Les prévisions d’embauche pour 2025 ont reculé de 34 %, au plus bas depuis 2010. Le message qui affleure est simple : le marché du travail se tend, et l’argument du « remplacement par l’IA » apparaît de plus en plus souvent dans les communications d’entreprises (Amazon, Microsoft, IBM…). Pour l’instant, toutefois, les statistiques (j’en ai consulté une quinzaine) forment des faisceaux d’indices, mais je n’ai trouvé aucun élément s’apparentant à une vraie preuve. Même si la chute de l’emploi humain au profit de l’IA ne fait guère de doute dans les 10 prochaines années.

Une peur à double fond : de la foule au labo

Cette angoisse n’est pas seulement externe (si la populace se rebelle). Elle est aussi interne : la peur de ce qu’ils sont en train de fabriquer. Dans un texte publié par The Atlantic, à partir du livre de la journaliste Karen Hao (Empire of AI), une scène de l’été 2023 chez OpenAI pourrait légèrement inquiéter les plus sensibles d’entre nous. Ilya Sutskever, alors directeur scientifique, lâche en réunion : « Une fois que nous serons tous dans le bunker… ». Un collègue le coupe : « Quel bunker ? ». Sutskever insiste, très sérieusement : « Nous construirons bien sûr un bunker avant de lancer l’AGI. » Puis il précise, en substance, que le jour où l’Intelligence Artificielle Générale (AGI) sera là, ce sera une rupture, « littéralement une apocalypse ». Ses inquiétudes ne visent pas seulement le scénario d’une IA surpuissante qui échapperait au contrôle humain et se retournerait contre ses créateurs. Elles portent aussi sur une réalité plus terre-à-terre : l’AGI attirera énormément de pouvoir et d’argent, concentrant des intérêts économiques et politiques énormes, attisant les rivalités. Et donc des risques bien concrets pour celles et ceux qui la conçoivent et la déploient, au cœur du réacteur.

Des propos extrêmes mais récurrents

Ces craintes peuvent sembler excessives. Pourtant, elles reviennent très fréquemment — comme un refrain apocalyptique lancinant. Elon Musk : « L’IA est potentiellement plus dangereuse que les armes nucléaires. […] Il y a une forte probabilité que nous finissions par nous détruire nous‑mêmes ». Sam Altman, en 2023 : « Il y a un scénario où l’AGI nous tue tous, et nous devons prendre cela très au sérieux ». Geoff Hinton (souvent présenté comme un « père » du deep learning), en 2023 : « Je pense que le risque que l’IA nous élimine est réel. Nous devons agiter le drapeau rouge maintenant ». Stephen Hawking (physicien), en 2014 : « Le développement d’une intelligence artificielle complète pourrait signifier la fin de la race humaine ». Le racisme 3.0 sera anti-humain, et l’hiver vient.

Promettre monts et merveilles tout en anticipant la fin du monde… c’est un peu comme si le capitaine du Titanic, voyant l’iceberg se rapprocher, souriait aux passagers en leur assurant que la situation est sous contrôle et que ce voyage serait définitivement le meilleur de leur vie, tout en préparant discrètement son gilet et son canot de sauvetage.

Dans ce flou total, sans élément vraiment décisif pour l’instant, prenons la chose au sérieux deux minutes, car la situation le mérite. Admettons que les opulents craignent le Grand Soir anti-IA : cela ne prouve pas que l’apocalypse arrive, cela prouve qu’un rapport de force s’ouvre. Les peuples sont bien vivants, et c’est cela qui les inquiète : une société qui se réveille, qui réclame des comptes, qui refuse d’être « optimisée » sans consentement.

C’est précisément dans ces moments-là que l’histoire cesse d’être subie et redevient discutée et choisie : nommer les risques, encadrer le marché, réguler les usages, protéger les citoyens, partager les gains. Car l’IA n’est peut-être pas seulement une innovation de plus : elle pourrait aussi être l’une des plus grandes transformations jamais produites par l’humanité.

Les élites creusent des issues de secours ; les peuples ouvrent des portes… pour peu qu’ils se bougent.

Voir aussi :

- « Les milliardaires et leurs bunkers de luxe ou quand les rats quittent le navire qu’ils ont coulé »

- « L’IA n’est pas un outil, c’est une délégation de pouvoir (vidéo) »

Edit 10/02/2026 16h10 : ajout du deuxième lien « Voir aussi » et correction d’orthographe 🙁

Cet article est publié sous licence Creative Commons CC BY‑ND 4.0. Détails ici.

Auteur : Napakatbra / LMOUS.

Article sous licence Creative Commons CC BY‑ND 4.0.